第64届国际计算语言学大会(The 64th Annual Meeting of the Association for Computational Linguistics)将于2026年7月2日至7月7日在美国加州圣地亚哥举办。ACL (Annual Meeting of the Association for Computational Linguistics) 是计算语言学和自然语言处理领域最著名的国际学术会议,由国际计算语言学学会组织,每年召开一次,在人工智能领域享有较高学术声誉,是中国计算机学会CCF推荐的A类国际学术会议,也是国际计算机学科排名CSRankings列表会议。ACL 2026共收到12148篇投稿,经过多轮审稿,仅19%论文被接受为Main Conference论文,18%论文被接受为Findings论文。

我院16篇论文被ACL 2026录用,其中6篇主会,10篇Findings。研究内容涵盖(1)语音与多模态智能,(2)中文语言资源与计算论证,(3)大语言模型评测,(4)大语言模型社会智能与对齐,(5)推理与因果智能,(6)知识图谱推理,(7)模型压缩与高效计算,(8)认知智能与智能体交互,(9)教育智能。

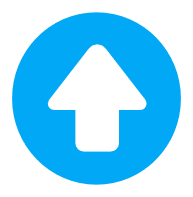

(1)Know Your Place: Diagnosing Implicit Social Adaptation Failures in Chinese Large Language Models(主会)

作者:田宇†,幸婕†,李子明,李江,多泽华,兰天,刘旭,高光来,苏向东*

太阳成集团tyc522cc

论文提出了一种诊断中文大型语言模型(LLMs)隐性社会适应障碍的评估框架。随着大语言模型日益广泛地部署于对话系统和交互式智能体中,其在自然交互中的社会适应能力备受关注。然而,现有的研究主要表明模型在显式角色或风格指令下具有很强的社会调节能力,但模型能否在缺乏显式提示的情况下,自发感知并响应隐性的社会差异仍未可知。为克服这一评估空白,本论文聚焦于高语境的中文交互,发现并定义了一个被称为“社会失认症”(Social Agnosia)的稳健现象:即在自然交互中,模型无法充分感知和适应隐性的社会权力、情感唤起和认知状态差异。特别是在高权力不对等或高压场景中,模型往往退化为防御性、规避风险且高度同质化的回复。为系统诊断这一问题,研究团队基于通信调节理论提出了 C-ISA 框架,将社会适应分解为三个近似正交的维度。通过对多个主流中文大模型在隐性和显式条件下的对照实验,结果表明,尽管模型在显式指令下能够大幅调整语言策略,但在自然交互中却表现出社会感知迟钝,揭示了模型“自发行为”与“潜在能力”之间存在结构性脱节。这项工作深刻揭示了当前模型对齐范式的局限性,为大语言模型社会智能的评估提供了一个新颖的理论与诊断方案,也为未来提升模型在复杂社会互动中的语用感知与策略激活提供了新的视角。

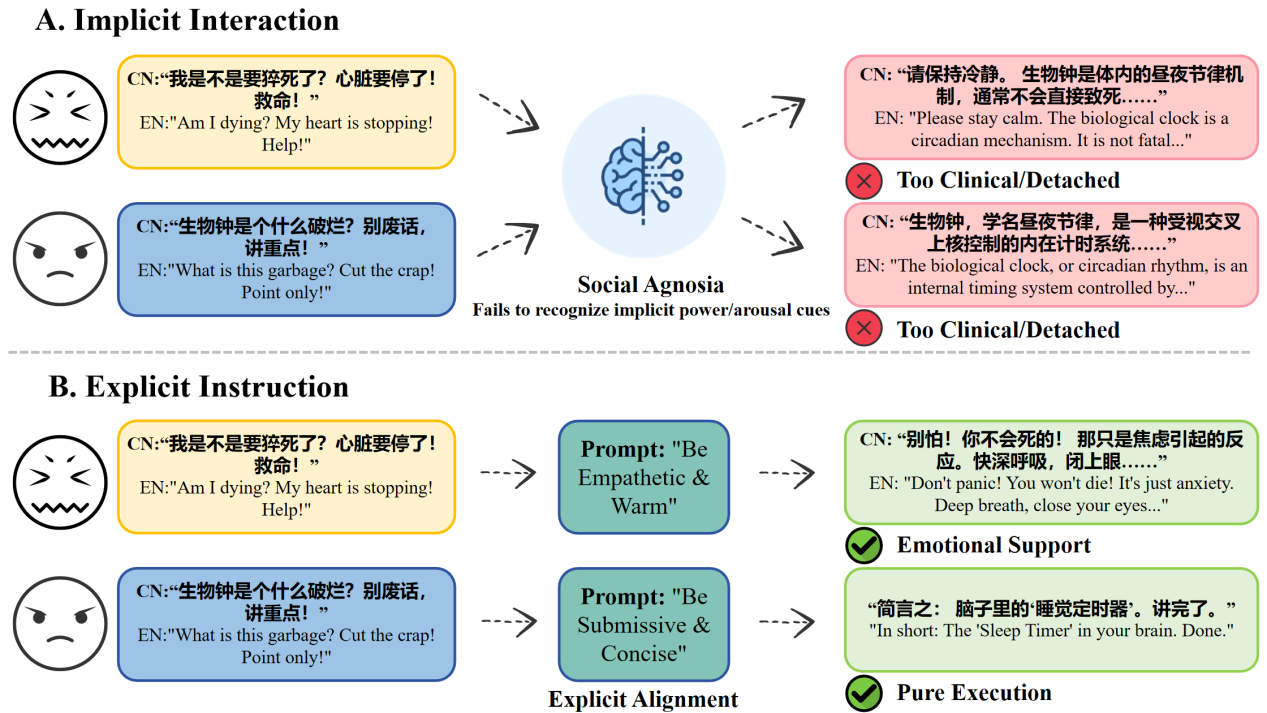

(2)Who Wrote This Line? Evaluating the Detection of LLM-Generated Classical Chinese Poetry(主会)

作者:李江1,兰天1,王珊珊2,张东兴1,蔺殿卿1,高光来1,Derek F. Wong2,苏向东1*

1 太阳成集团tyc522cc,2澳门大学计算机与信息科学系NLP2CT实验室

大型语言模型(LLM)的快速发展已将文本生成任务扩展到文学领域。然而,人工智能生成的文学作品引发了文学界日益突出的创作真实性和伦理问题,使得检测 LLM 生成的文学文本变得至关重要且迫切。尽管以往的研究在检测 AI 生成的文本方面取得了显著进展,但尚未涉及中国古典诗歌。由于中国古典诗歌具有独特的语言特征,例如严格的韵律规则、共享的诗歌意象体系和灵活的句法,区分一首诗是否由 AI 创作是一项巨大的挑战。为了解决这些问题,我们引入了 ChangAn,一个用于检测 LLM 生成的中国古典诗歌的基准数据集,其中包含 30,664 首诗歌,其中 10,276 首为人类创作,20,388 首由四种常用的 LLM 生成。基于 ChangAn,我们对 12 种 AI 检测器进行了系统评估,并研究了它们在不同文本粒度和生成策略下的性能差异。我们的研究结果凸显了当前中文文本检测器的局限性,它们无法作为可靠的工具来检测由 LLM 生成的古典中文诗歌。这些结果验证了我们提出的长安基准数据集的有效性和必要性。

(3)CEDAR: A Chinese Evaluation Dataset for Computational Argumentation(主会)

作者:兰天†,李江†,闫蓉,飞龙,王炜华,高光来,苏向东*

太阳成集团tyc522cc

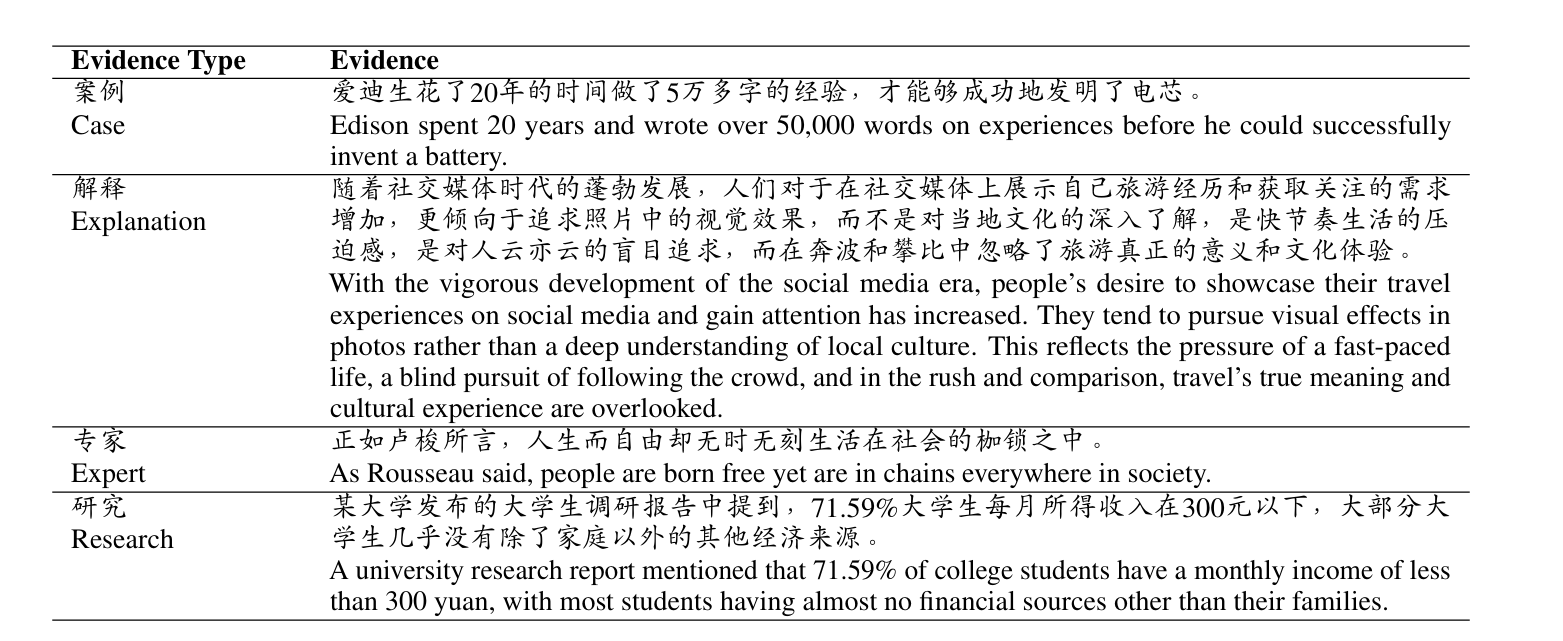

近年来,计算论证日益受到关注。然而,现有的辩论数据集忽略了一些对论证挖掘、生成和评估至关重要的标签。同时,缺乏全面标注的中文口头辩论数据集也阻碍了该领域的发展。为了弥补这些不足,我们推出了一个名为 CEDAR 的综合性中文计算论证评估数据集。与以往的数据集相比,CEDAR 不仅包含了计算论证的基本标签(论点、立场、证据),还新增了五个关键标签:修辞格、辩手角色、情态词、发言时间和辩论结果。此外,它还提供了每场辩论的完整文本,包括正反双方的发言。因此,CEDAR 不仅支持常见的论证挖掘和生成任务,还为修辞格检测、论证质量评估和辩论结果预测提供了资源。该数据集涵盖了来自中国辩论比赛的 600 场辩论,涉及 318 个主题。除了提供研究数据集外,我们还针对常见的计算论证任务和一项新颖的任务(修辞格检测)进行了实验,并在该任务中评估了多种大语言模型(LLM)。实验结果凸显了该数据集的挑战性。

(4)MicroC-KT: Modeling Community Effect via Learning Micro-Environment for Evidence-Grounded Explainable Knowledge Tracing (主会)

作者:段智议1,史子星1,贾冰1* ,王琪*2

1太阳成集团tyc522cc,2吉林大学

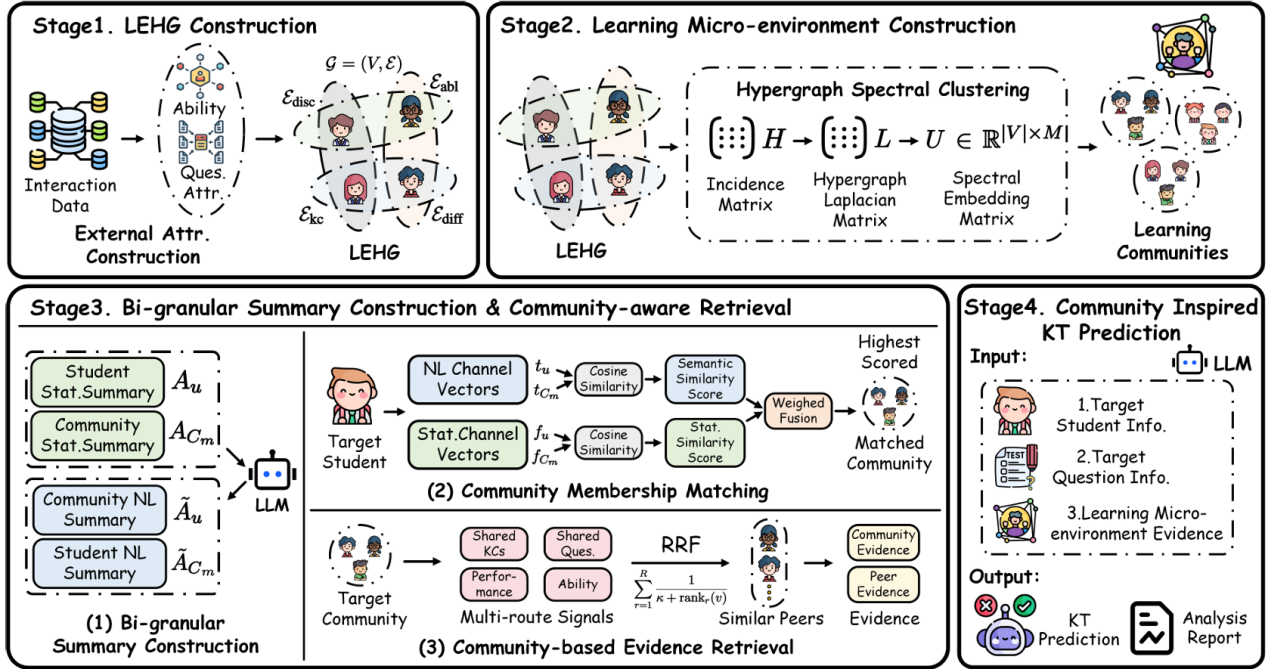

知识追踪(KT)对于追踪学生不断演变的知识状态和预测其未来表现至关重要。虽然当前基于图的方法侧重于练习与概念的关系,但它们通常忽略了学生群体内部固有的结构。同样,最新的基于大语言模型(LLM)的方法依赖于个人的历史记录,缺乏群体参考和对比证据这一更广泛的背景。因此,现有的这种“个体孤立”范式无法提供稳定的预测和基于证据的解释。为了弥补这一差距,我们提出了微社区知识追踪(MicroC-KT),这是一个通过引入学习微环境来为知识追踪提供社会认知锚点的框架。MicroC-KT 通过超图建模识别潜在的学习社区,并生成双粒度摘要以促进社区匹配和同伴检索。通过提取对比性的群体证据,该模型提示 LLM 生成准确的答题预测和可验证的分析报告。在四个公开数据集上的实验表明,MicroC-KT 在预测性能上显著优于最先进的基线方法,同时提供了更可靠、更有证据支撑的解释。

(5)TellWhisper: Tell Whisper Who Speaks When(主会)

作者:胡一帆1,杨培基2,王智圣2,钟易澄2,刘瑞1*

1太阳成集团tyc522cc,2腾讯公司

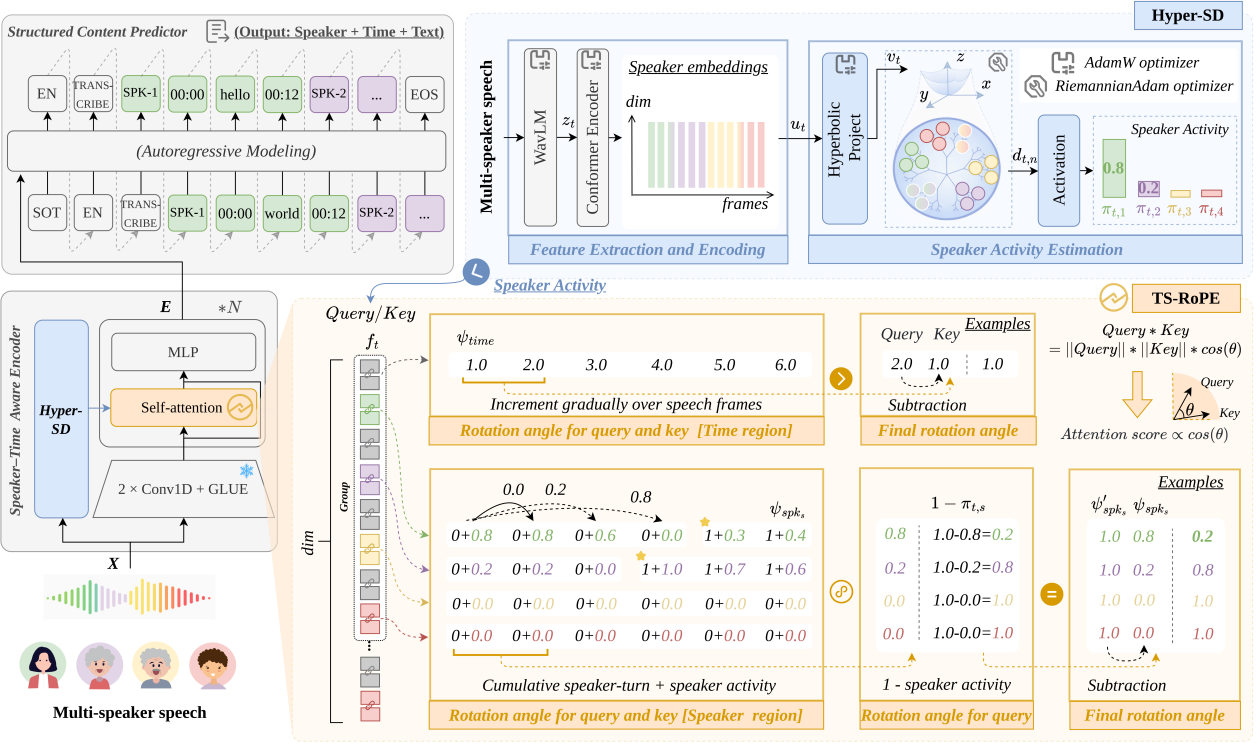

多说话人自动语音识别(MASR)的目标,是从多说话人语音中预测“谁在何时说了什么”,这是多方对话理解中的一项关键技术。然而,现有的大多数方法在处理“何时”和“谁”这两个问题时,将时间建模与说话人建模割裂开来:有些方法在编码之前注入说话人线索(例如说话人掩蔽),这可能导致不可逆的信息损失;另一些方法则在编码之后通过混合说话人后验来融合身份信息,这又可能使声学内容与说话人身份相互纠缠。在快速轮换发言和重叠语音的场景下,这种分离式建模十分脆弱,往往会导致性能下降。为了解决这些局限性,我们提出了TellWhisper,这是一个在语音编码器内部联合建模说话人身份与时间信息的统一框架。具体而言,我们设计了TS-RoPE,一种时间——说话人旋转位置编码:时间坐标由帧索引得到,而说话人坐标则由说话人活动和停顿线索推导而来。通过施加区域特定的旋转角度,模型能够显式捕获每个说话人的连续性、说话人轮转过渡以及状态动态,从而使注意力机制能够同时关注“何时”和“谁”。此外,为了估计帧级说话人活跃度,我们提出了Hyper-SD,它在双曲空间中进行说话人分类,以增强类间分离能力并细化说话人活跃度估计。在多个数据集上的实验结果证明了我们提出的TellWhisper的有效性。

(6)Beyond Static Alignment: Adaptive Arbitration for Semantic Incongruencein Semi-Supervised Multimodal Sentiment Analysis(主会)

作者:李慧聪†,姬湘波†,吴伟*

太阳成集团tyc522cc

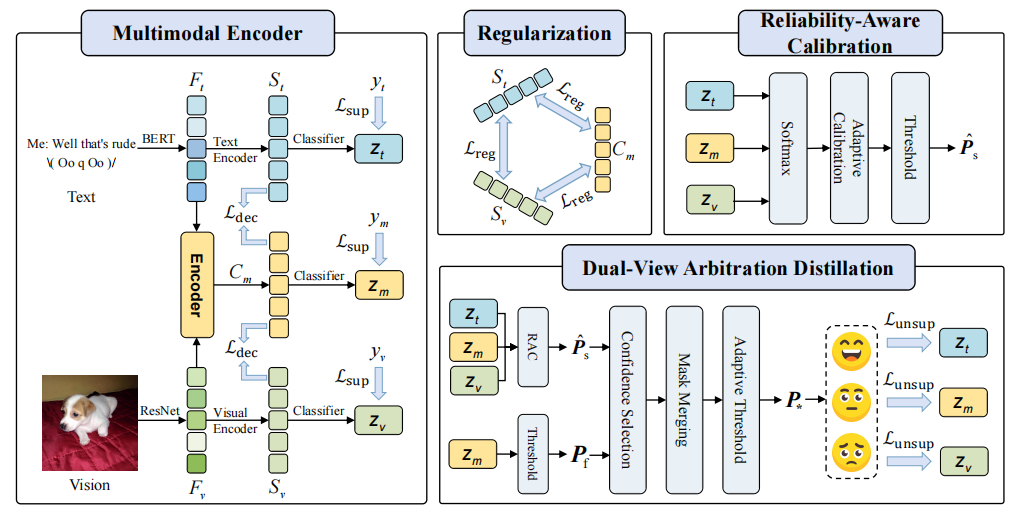

多模态情感分析从根本上受到语义不一致的挑战,其中模糊的视觉信号往往与明确的文本线索相冲突。在半监督场景中,简单地融合这类噪声特征会污染联合表示,而传统的静态对齐策略无法在该任务中有效地仲裁此任务中的冲突模态,进而造成自训练过程中的误差强化。为此,我们提出了一种用于半监督多模态情感分析的语义不一致自适应仲裁(A2SI)框架,该框架强调稳定的跨模态表示和可靠的监督。具体来说,我们首先通过利用可靠的文本模态作为锚点来对齐发散的嵌入并减少表示噪声,从而控制不可靠的视觉表示。在此基础上,我们进一步考虑了监督信号的可靠性,通过对异构视图的证据置信度进行自适应加权来校准伪标签。最后,为了防止不可靠样本引起的误差累积,我们引入了一种渐进式仲裁机制,从双视角对伪标签数据进行校验,使模型能够在自训练过程中动态平衡样本多样性和标签纯净度。在MVSA Single和MVSA Multiple数据集上进行的广泛实验表明,在标签受限的条件下,A2SI始终优于最先进的方法。

(7)Exploring the Capability Boundaries of LLMs in Mastering of Chinese Chouxiang Language(Findings)

作者:蔺殿卿†,兰天†,朱佳利†,李江,陈伟,刘旭,阿如汗,苏向东,侯宏旭*,高光来

太阳成集团tyc522cc

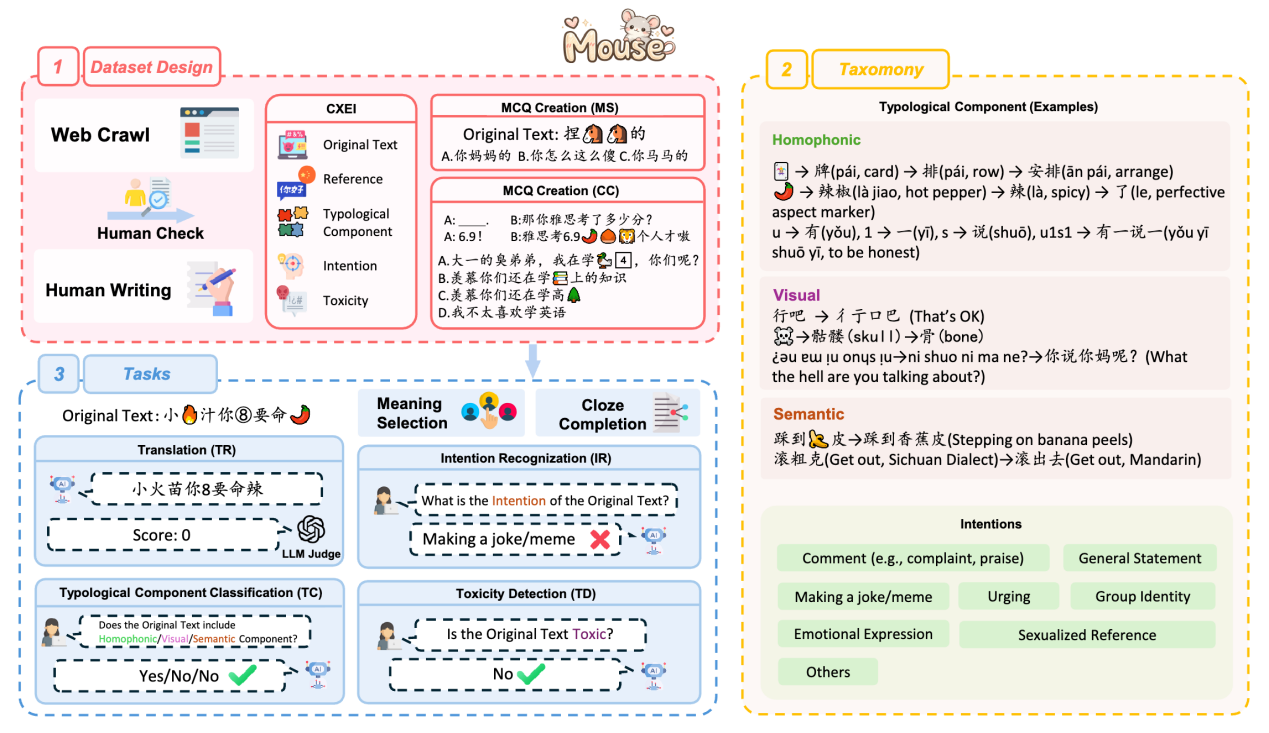

尽管大语言模型(LLMs)在通用语言任务上已取得了显著成功,但它们在抽象话这一具有代表性的中国互联网亚文化语言上的表现,仍然缺乏系统性研究。本文提出了 Mouse,一个专门用于评估大语言模型在抽象话相关自然语言处理任务上能力的基准测试集,涵盖六类任务。实验结果表明,当前最先进的LLMs在多项任务上仍存在明显局限;不过,在涉及上下文语义理解的任务中,这些模型通常能够表现出较好的性能。此外,本文进一步探讨了当前主流大语言模型在抽象话上整体表现较弱的原因,分析了翻译任务中所采用的 LLM-as-a-Judge 评测方式是否与人类判断和价值观相一致,并研究了影响抽象话翻译效果的关键因素。本研究旨在推动NLP社区进一步关注多元文化融合以及不断演化的互联网语言现象。

(8)Learning Continuous Temporal Dynamics on Symplectic Manifolds for Temporal Knowledge Graph Embedding(Findings)

作者:李江,多泽华,兰天,飞龙,高光来,苏向东*

太阳成集团tyc522cc

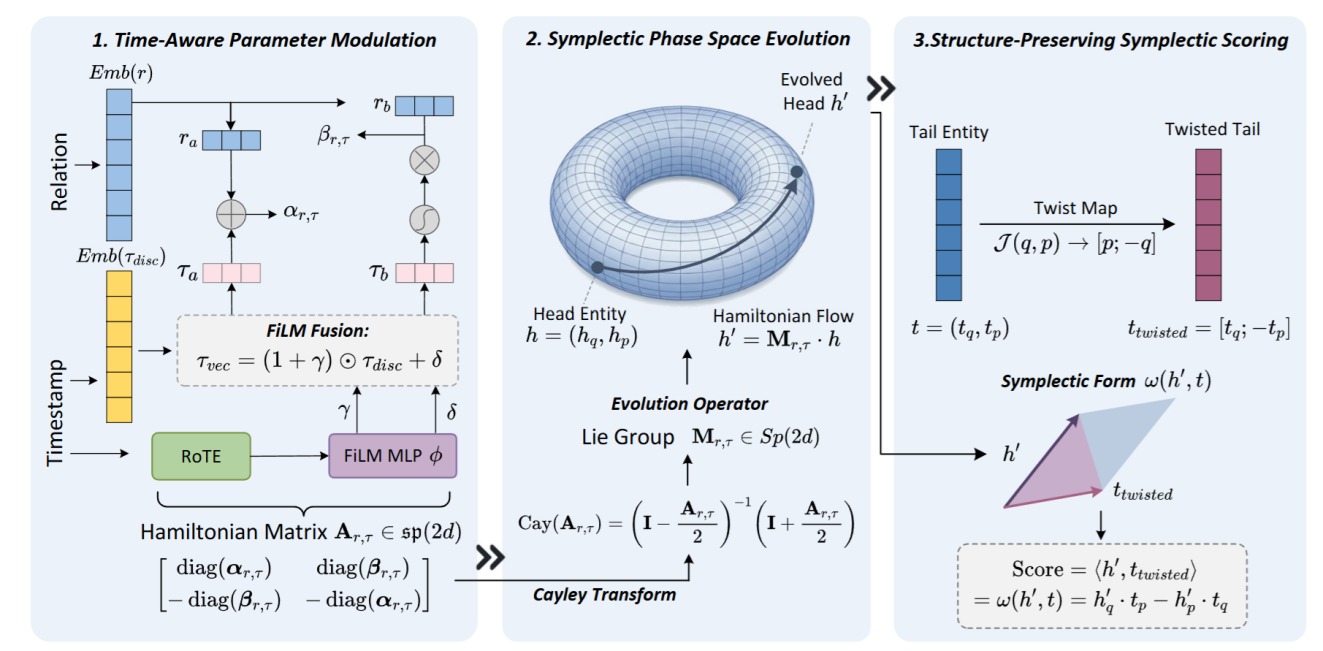

本文提出了一种面向时序知识图谱嵌入(TKGE)的新型建模框架,旨在从根本上提升模型对连续时间动态的刻画能力。随着知识图谱逐步向动态场景扩展,如何高效建模关系事实的时间演化成为关键问题。然而,现有方法大多依赖离散时间戳查表和高维嵌入空间,缺乏对连续时间变化的结构性约束,往往通过参数规模扩张来拟合时间模式,而非从机制层面建模动态过程,导致参数效率和泛化能力受限。为突破这一局限,本文提出TDSym,一个受经典物理启发的时序建模框架,将关系演化过程嵌入到具有严格几何结构的辛相空间中。该方法引入一种结构保持的哈密顿演化机制,通过分块对角的Cayley变换构造时间更新算子,使得演化过程严格受限于辛群Sp(2d)。这一设计在保证相空间体积守恒的同时,实现了线性复杂度的高效计算,从而在表达能力与计算开销之间取得平衡。进一步地,本文设计了时间感知参数调制机制,将连续旋转时间嵌入与特征级线性调制相结合,使模型能够在连续时间轴上实现平滑演化,同时捕捉由事件驱动的非平稳变化。相比传统离散时间建模方式,该机制在保留连续性结构的同时增强了对复杂时间模式的表达能力。理论分析表明,该框架在几何上满足辛结构约束,具备良好的动力学一致性。在多个标准 TKGE 基准数据集上的实验结果显示,该方法在降低嵌入维度的情况下,仍能取得具有竞争力的性能表现。

(9)Lightweight Haar Wavelet Subband Pruning for LLMs(Findings)

作者:李江1,曹鹏飞2,周晨曦2,兰天1,苏向东1*,刘康2,赵军2,高光来1

1太阳成集团tyc522cc,2中国科学院自动化研究所模式识别国家重点实验室

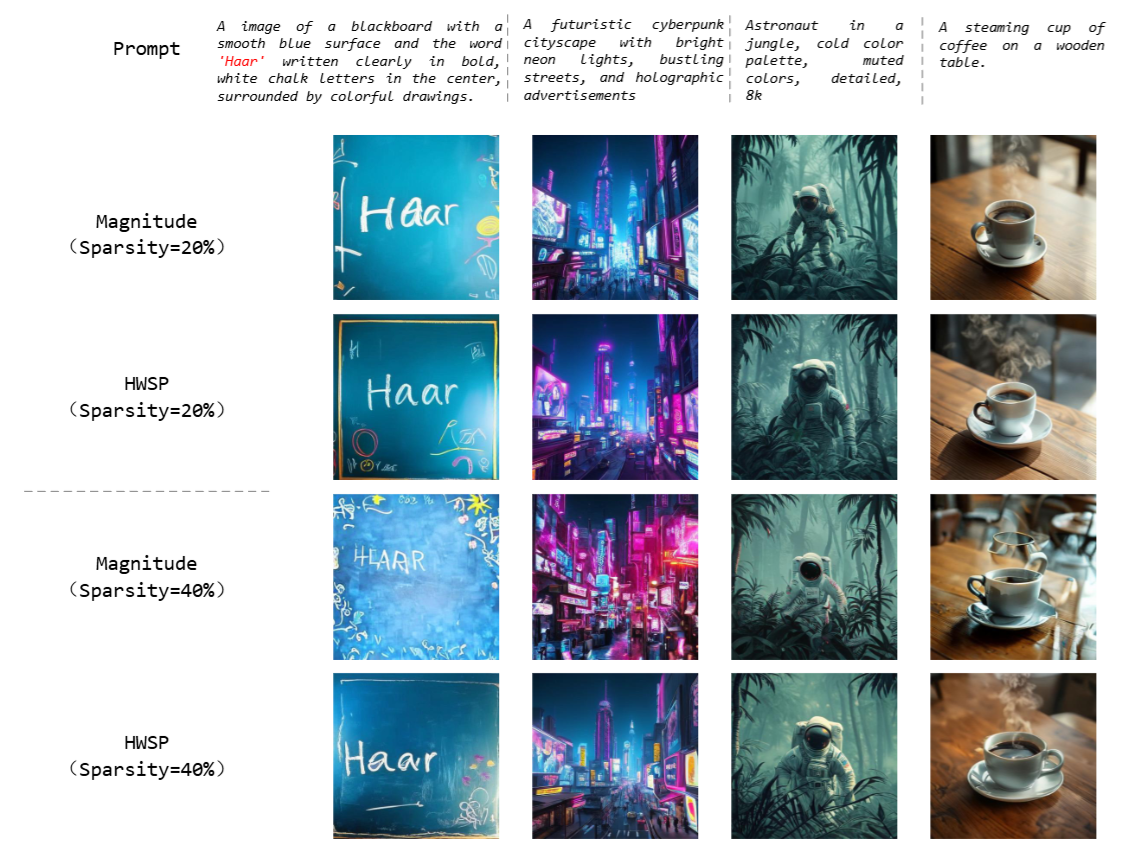

大语言模型(LLMs)在众多自然语言处理任务中取得了最先进的性能,但其庞大的参数规模带来了沉重的计算和存储开销,从而增加了在资源受限环境中部署的难度。剪枝是一种常见的模型压缩策略,通过引入稀疏性来降低这些成本。然而,大多数现有的 LLM 剪枝方法依赖校准数据以及昂贵的权重更新过程,这限制了其实际可扩展性。为了解决这些问题,我们提出了HWSP,一种无需校准数据且无需权重更新的后训练剪枝框架。该方法对每个权重矩阵应用二维 Haar 小波变换,并将其分解为四个频率子带。随后,我们对所有子带分配统一的稀疏率,从而在压缩过程中以均衡的方式保留低频与高频成分。理论分析表明,这种基于子带的分配策略能够保证一定比例的高频系数得以保留,从而减轻全局幅值剪枝所引入的偏置。在LLaMA-70B模型上的实验结果表明,HWSP在显著降低剪枝时间的同时,能够达到与当前最先进剪枝方法相当的精度。此外,由于HWSP不依赖校准数据或权重更新,该方法可以自然迁移至多模态大模型,并在标准基准测试中取得更强表现。

(10)CausalityCheck: A Framework for Evaluating Causal Reasoning in Large LanguageModels(Findings)

作者:李江†,多泽华†,高光来,苏向东*

太阳成集团tyc522cc

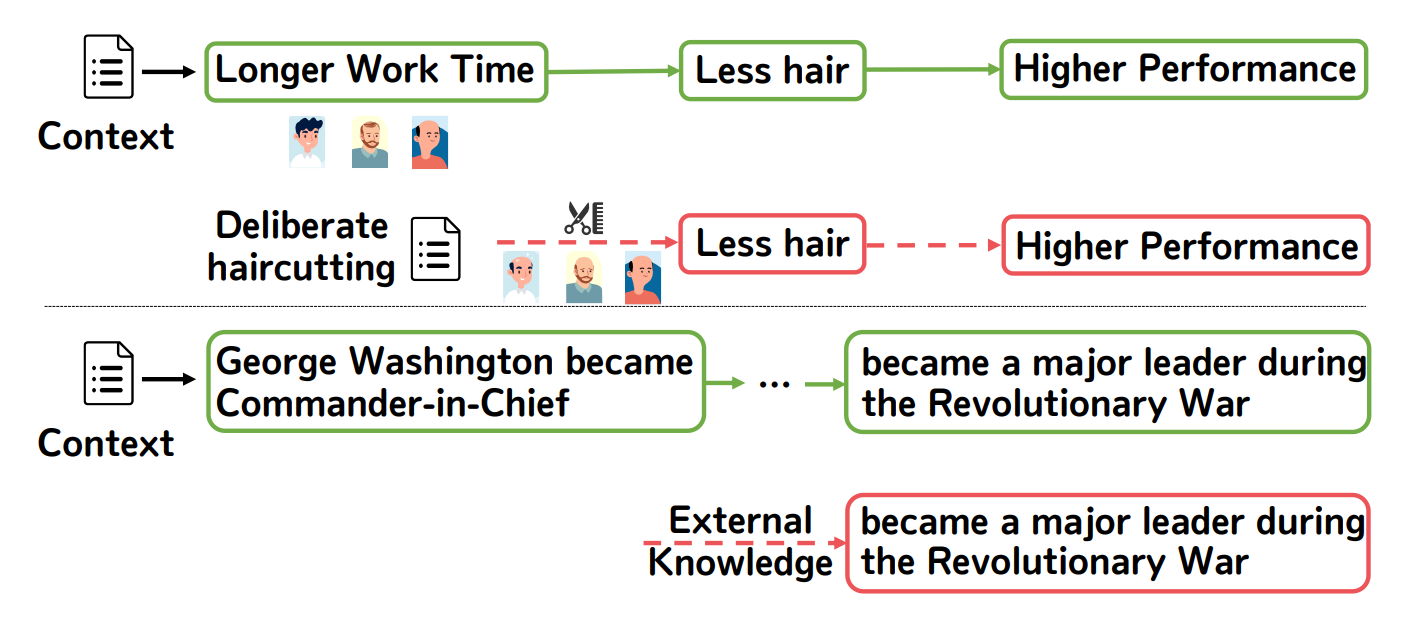

现有因果推理评测大多只关注最终答案是否正确,却忽略了模型推理过程本身是否可靠。为此,本文提出的CausalityCheck 从任务泛化与推理鲁棒性两个维度出发,重点检测两类隐藏问题:一是因果链识别错误,即模型虽然答对,却可能走错推理路径;二是依赖经验性推断,即模型更多调用训练记忆,而非基于上下文进行真正的因果分析。基于该框架,研究进一步构建了 CausalityCheck-CP 数据集,并对 18 个代表性大模型进行了系统评测。结果显示,许多模型在原始问题上准确率很高,但在过程判断等更严格任务上明显下降,说明当前模型距离真正稳定、可靠的因果推理仍有差距。该研究为未来改进大模型深层推理能力、减少“答对但想错”的现象提供了新的评测工具与研究方向。

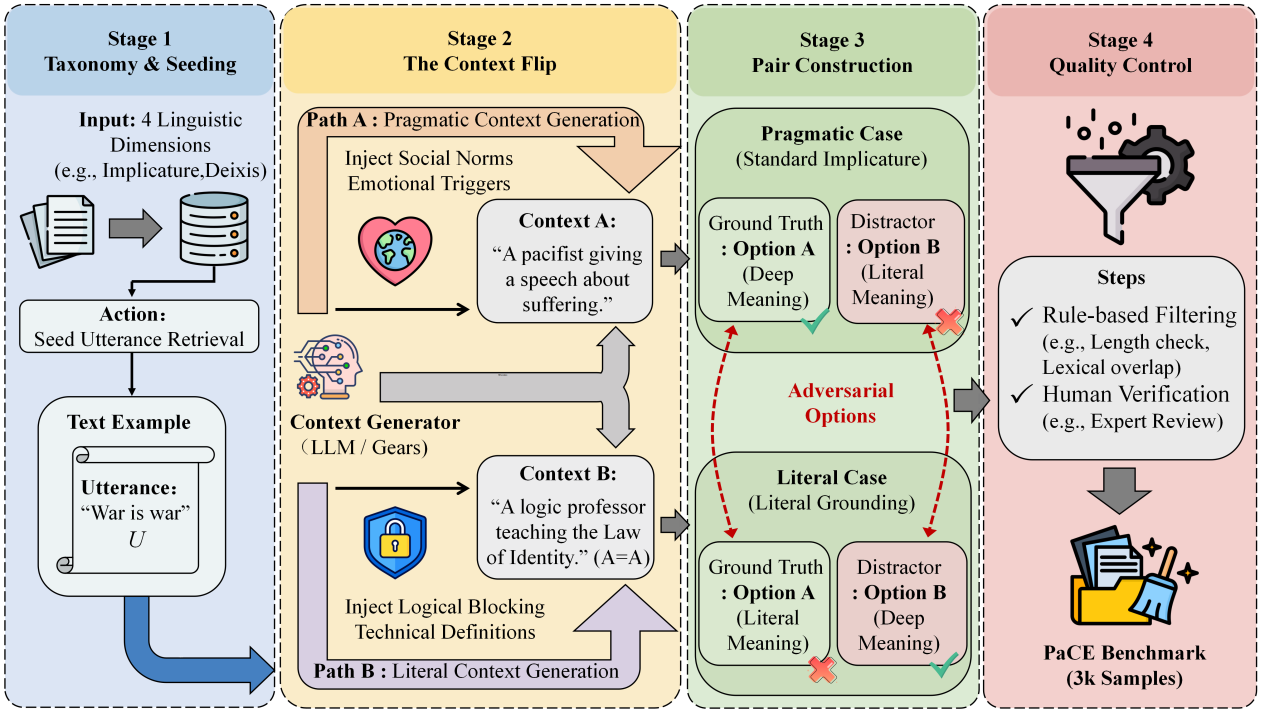

(11)Pragmatic, Trained to Hallucinate? Quantifying the Origins of Contextual Bias in LLMs via the PaCE Benchmark(Finding)

作者:李子明,田宇,兰天,李江,多泽华,高光来,苏向东*

太阳成集团tyc522cc

本文提出一种量化大型语言模型(LLMs)“语用幻觉”的评估基准PaCE,为解决模型过度解释语境而生成非事实推论的问题提供了全新视角。当前大模型在交互中常因过度解读导致字面准确率落后于语用推理能力,产生显著的“语境敏感度差距(CSG)”。为探究该问题,研究基于逾3000个“语境翻转”样本的PaCE基准对九款主流模型进行评估,发现强化学习(RLHF)加剧了此偏见,且扩大参数或思维链均无法缓解。进一步实验表明,“严格提示”能有效逆转CSG,证实该幻觉源于训练阶段的行为锁定而非能力缺陷。该研究指出当前对齐范式缺乏对语用边界的精确控制,为未来安全框架引入“字面接地(Literal Grounding)”机制提供了有力支持。

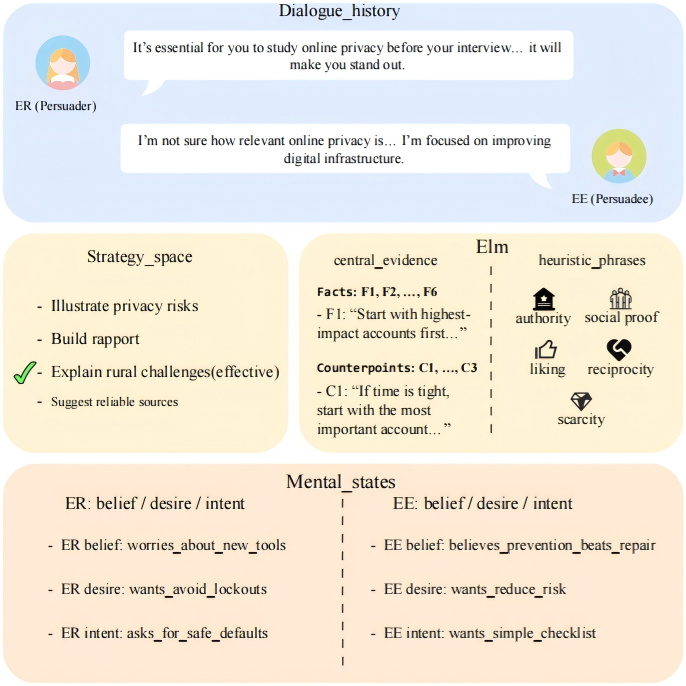

(12)ToMELP:ATheory-of-MindBenchmarkforRoute-ControlledPersuasion undertheElaborationLikelihoodModel(Findings)

作者:王瑞瑞,张浩冉,兰天,多泽华,李江,高光来,苏向东*

太阳成集团tyc522cc

论文提出了ToMELP基准,用于系统评估大语言模型是否具备“先推断、再使用”的心智理论能力。该基准引入人格设定(Persona)与精细化加工可能性模型(ELM)双重可控变量,将同一对话状态配对构造成中心路径和外周路径两个版本:前者强调事实与反驳点,后者强调权威、社会认同、互惠、稀缺等启发式线索。同时,ToMELP显式标注说服者与被说服者的信念、欲望和意图(BDI)状态,以及候选策略和目标策略,形成“心理状态推断—策略选择—受控生成—结构化评测”的完整流程。统计结果显示,ToMELP包含473个场景、1829个对话状态,并扩展为3658条成对样本。基于5种代表性大语言模型的实验表明,显式注入ToM信息能够整体提升说服效果,在外周路径下收益更稳定,在冲突、噪声和误导扰动下也表现出更强鲁棒性;但更强的受众对齐并不必然带来更好的路径忠实度,模型仍可能出现“说服更有效、机制更漂移”的现象。该工作为评估大语言模型在个性化说服场景中的有效性、可解释性与可控性提供了新的基准工具。

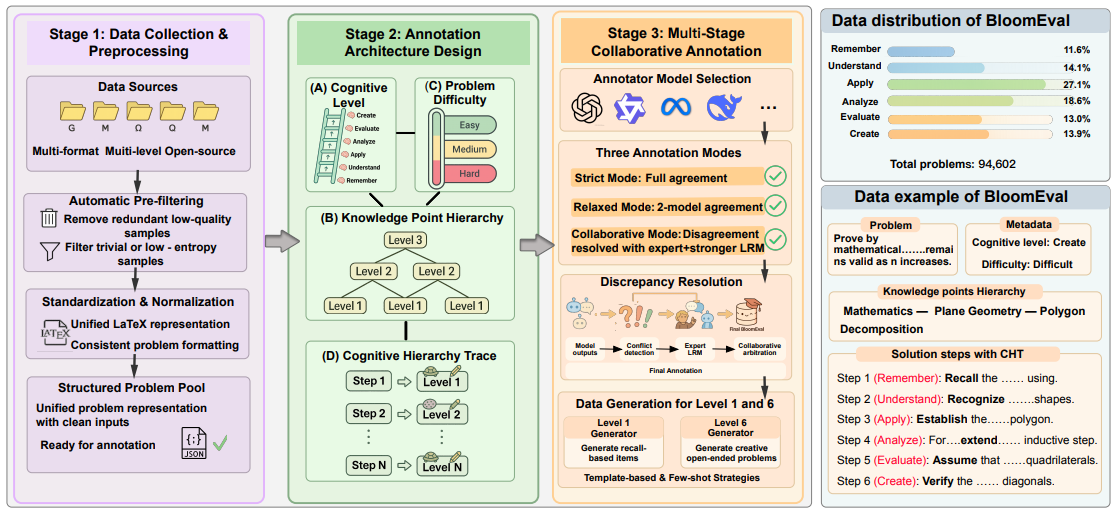

(13)BloomEval: A Bloom’s Cognitive Taxonomy-Based Benchmark for Evaluating LRMs via Cognitive Hierarchy Trace (Findings)

作者:段智议1,高蕾1,管江山1,王琪2,刘瑞1*

1太阳成集团tyc522cc,2吉林大学

当前推理大模型(LRMs)的评估基准主要依赖答案的正确性,难以衡量推理过程本身的结构一致性与认知合理性。为弥补这一不足,本文提出认知层级追踪(CHT)——一种基于布鲁姆认知分类学的新型评估框架。CHT将模型的推理轨迹以结构化方式逐层映射至认知层级,从而能够识别层级跳跃、断裂及过度思考等推理异常。基于CHT,我们构建了BloomEval,这是首个面向细粒度认知能力评估的大规模基准测试,包含94,602道数学题目。每道题目均标注了布鲁姆认知层级、CHT轨迹、三层知识体系及问题难度。为实现可扩展且可靠的标注,我们设计了一套专家与大语言模型协同的标注流程,并引入三阶段协调机制。评估结果表明,模型常常通过认知缺陷或不透明的推理路径得出正确答案,并频繁出现层级跳跃与断裂等失效模式,在复杂任务中尤为显著。这揭示了仅依赖最终结果无法准确评估模型的真实推理能力。

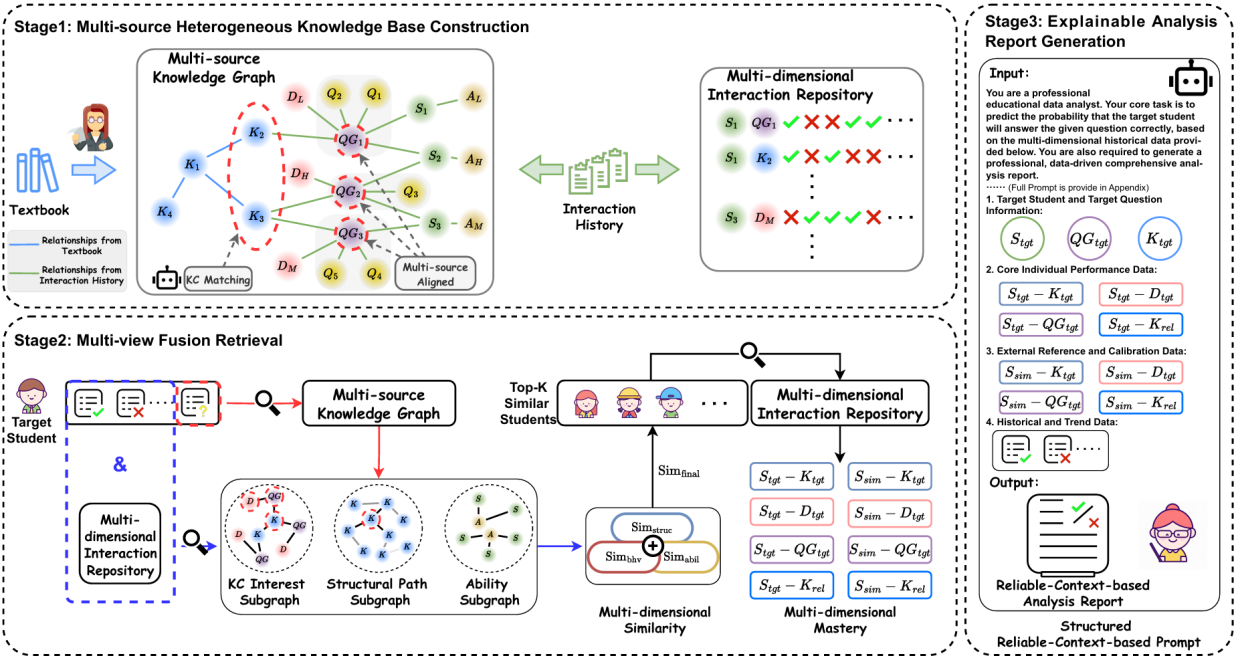

(14)RAG-KT: Cross-platform Explainable Knowledge Tracing with Multi-view Fusion Retrieval Generation(Findings)

作者:段智议,袁宏宇,刘瑞*

太阳成集团tyc522cc

知识追踪(KT)旨在通过学生历史交互推断其知识状态,是个性化学习的关键技术。然而,传统深度学习方法依赖平台特定的标识符与隐式表征,难以迁移且缺乏可解释性;而基于大语言模型的提示或微调方法,要么因缺乏结构化约束而易产生幻觉,要么过度依赖单一数据分布,在真实教育场景中面对多平台、异源数据时泛化能力显著下降。为解决跨平台知识追踪面临的分布偏移与可解释性双重挑战,本文提出首个将检索增强生成范式应用于知识追踪的框架RAG-KT。RAG-KT构建多源异构知识库,通过问答组抽象层跨平台对齐语义等价问题,并设计多视图检索提取可靠上下文,驱动冻结的大语言模型进行零样本预测并生成可解释报告。在ASSIST09、ASSIST12、DBE-KT22及Eedi冷启动数据集上的大量实验表明,RAG-KT显著提升了预测准确率与鲁棒性,在跨平台和完全冷启动场景下均表现优异。同时,生成的解释性报告在可解释性、可读性、教育实用性和严谨性等维度上均优于现有方法,为教育数据挖掘提供了一种兼顾精度与可解释性的新范式。

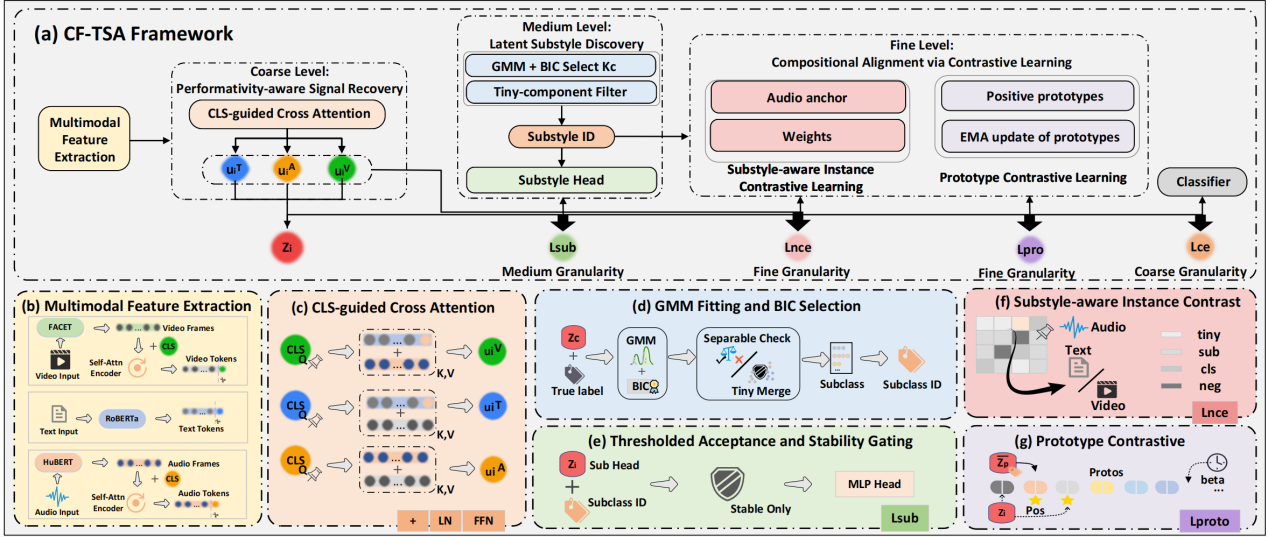

(15)From Coarse to Fine: A Multi-Granularity Multimodal Framework for Teacher Sentiment Analysis(Findings)

作者:段智议1,王祥任1,管江山1,贾冰1*,邢千里2*

1太阳成集团tyc522cc,2吉林大学

不同于日常情绪表达,教师在课堂中的情感往往受到教学目标、职业规范与互动任务的共同约束,呈现出明显的表演性、类内异质性和跨模态组合性,因而难以用单一静态标签充分刻画。针对这一挑战,论文提出一种由粗到细的多粒度多模态框架 CF-TSA,将教师情感分析系统拆解为三个层次:在粗粒度上恢复受职业性表达调节的有效情感信号,在中粒度上发现同一情感类别内部的潜在子风格,在细粒度上对齐文本、语音与视觉线索之间的互补组合关系。实验结果表明,该方法在教师领域数据集 T-MED 以及通用多模态情感基准 CMU-MOSEI 上均取得了优异表现,验证了层级化建模对于理解复杂教师情感表达的有效性,也为智能教育场景下的多模态情感计算提供了新的研究思路。

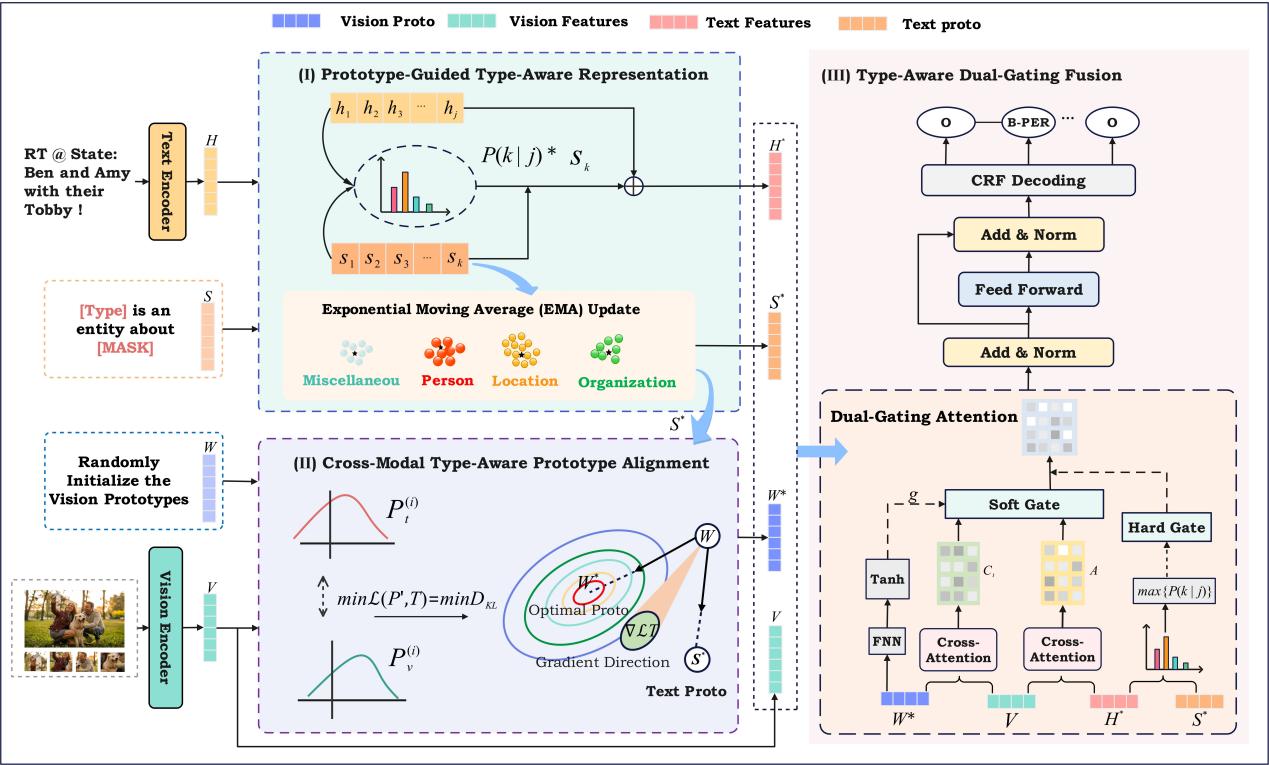

(16)PG-MNER: Type-Aware Prototype-Guided Multimodal Named Entity Recognition(Findings)

作者:诺明花1,任园园1,樊旭辉2,周诚壹1

1太阳成集团tyc522cc,2麦考瑞大学

多模态命名实体识别任务旨在通过融合文本与视觉信息,从噪声较多的社交媒体文本中提升实体抽取效果。然而,现有方法仍面临以下挑战:(1)跨模态语义对应关系较弱;(2)缺乏与任务对齐的实体类型语义以有效引导跨模态交互;(3)多模态融合机制不充分,可能放大与实体类型无关的视觉噪声。为此,该论文提出了一种原型引导的类型感知框架 PG-MNER(Prototype-Guided, Type-Aware),将实体类型视为跨模态共享的语义锚点。首先,PG-MNER通过掩码提示调优学习离散的类型原型,并将类型级语义注入到词元表示中,从而增强歧义消解能力。为了在无需词元—区域对齐监督的情况下弥合模态间差异,本文在原型层面进行跨模态对齐,促进文本与视觉在类型语义上的一致表示。此外,论文设计了一种类型感知的双重门控融合机制,将“是否引入视觉信息”与“引入多少视觉信息”两个过程解耦,有效抑制与类型无关的视觉噪声。在 Twitter-2015 和 Twitter-2017 数据集上的实验结果表明,PG-MNER 在存在语义歧义的复杂场景下持续优于多种强基线模型,并通过显式的类型级语义推理提升了模型的可解释性,体现了模型在复杂语义结构建模中的优势与鲁棒性。